Imagina abrir tu feed matutino y encontrarte una fotografía que parece sacada de la vida real, pero que nunca ocurrió. Hace apenas unos días, la política española se encontró con esta realidad cuando una imagen generada por inteligencia artificial mostraba al presidente del PNV, Aitor Esteban, saltando a una piscina. Lo que comenzó como un meme digital terminó provocando una crisis real entre formaciones políticas y obligó a cancelar reuniones oficiales. Es solo el último ejemplo de cómo los límites entre lo verídico y lo ficticio se han desdibujado.

La defensa de la propia imagen

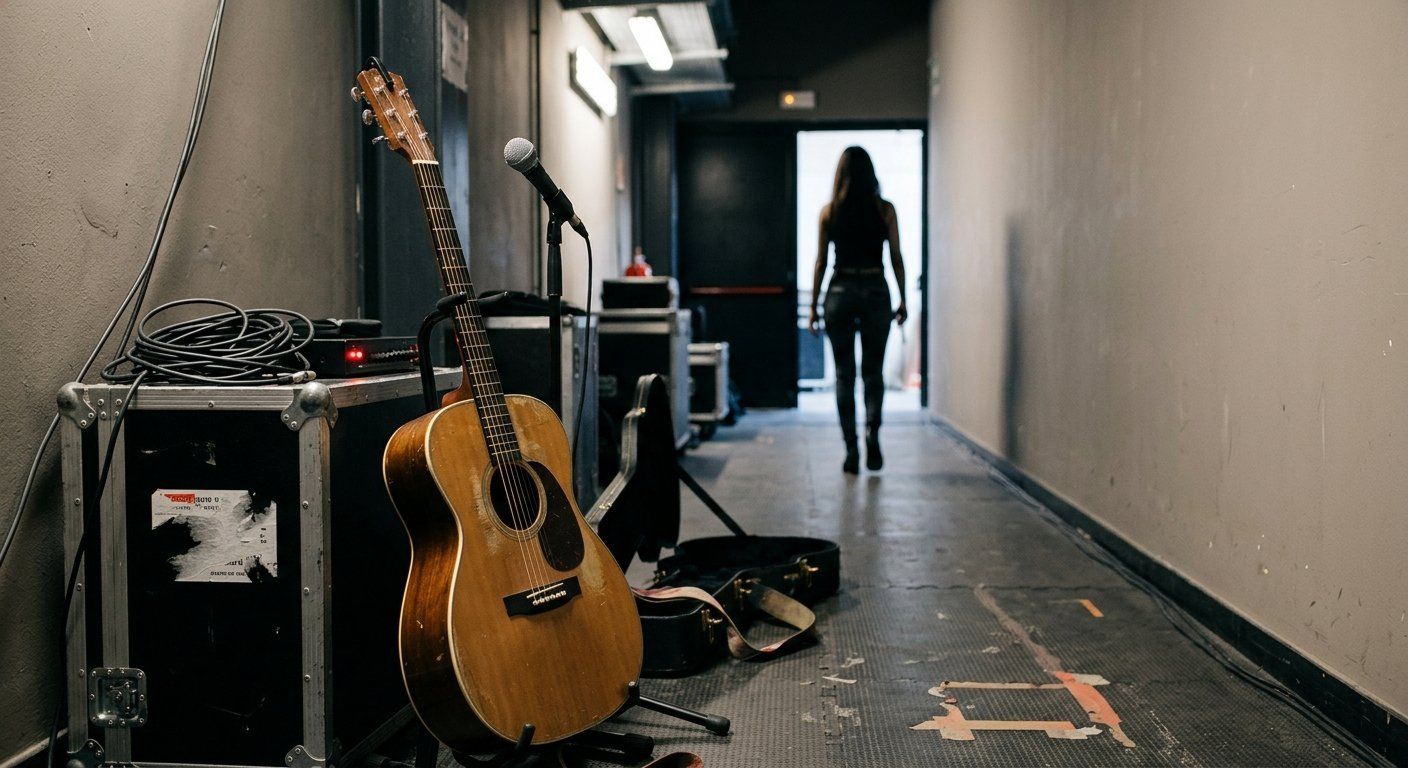

Mientras la clase política lidia con las consecuencias, figuras globales ya están tomando medidas preventivas. Taylor Swift ha registrado su voz y una imagen icónica con guitarra como marcas comerciales. Su objetivo es claro proteger su autonomía digital ante el uso no autorizado de su estilo o esencia, algo que el copyright tradicional no cubre plenamente. Esta estrategia busca contrarrestar el aumento de deepfakes y usos engañosos que amenazan la integridad pública de los artistas.

Pero registrar una marca no es un escudo infalible. Aunque permite actuar legalmente contra usos comerciales engañosos, no puede detener todas las imitaciones generadas por IA, especialmente aquellas creadas de forma anónima o sin fines de lucro. La tecnología avanza más rápido que la burocracia legal, y cada vez es más difícil distinguir quién está detrás de la pantalla.

El dilema de la verdad digital

En España, el entorno nacionalista calificó la imagen del político como «indecente», demostrando cómo estos contenidos afectan directamente a la convivencia social. Sin embargo, también circulan clips donde actores como David Verdaguer imitan personajes famosos como Albus Dumbledore para el entretenimiento. Aquí surge la pregunta incómoda ¿hasta qué punto la parodia cruza la línea hacia el delito?

Artistas gráficos como Peridis han respondido al caso dibujando situaciones similares para criticar la apropiación indebida de imágenes. Pero la cuestión jurídica sigue abierta, y nadie tiene claro quién fija ese umbral cuando la herramienta molesta o engaña. Un reporte técnico reciente advierte sobre un incremento alarmante de fraudes mediante estas tecnologías.

Los expertos coinciden en que las soluciones aisladas no bastan. Se necesita una regulación sensata y profunda de las herramientas de IA para proteger la imagen de artistas y personas en general. Además, es crucial implementar marcas de agua digitales y sistemas de verificación del origen de los contenidos. Sin educación de los usuarios para detectar manipulaciones, la confianza en lo que vemos quedará severamente comprometida. Mientras tanto, seguimos navegando en un océano donde lo que brilla con luz propia a veces es solo un reflejo calculado por algoritmos.