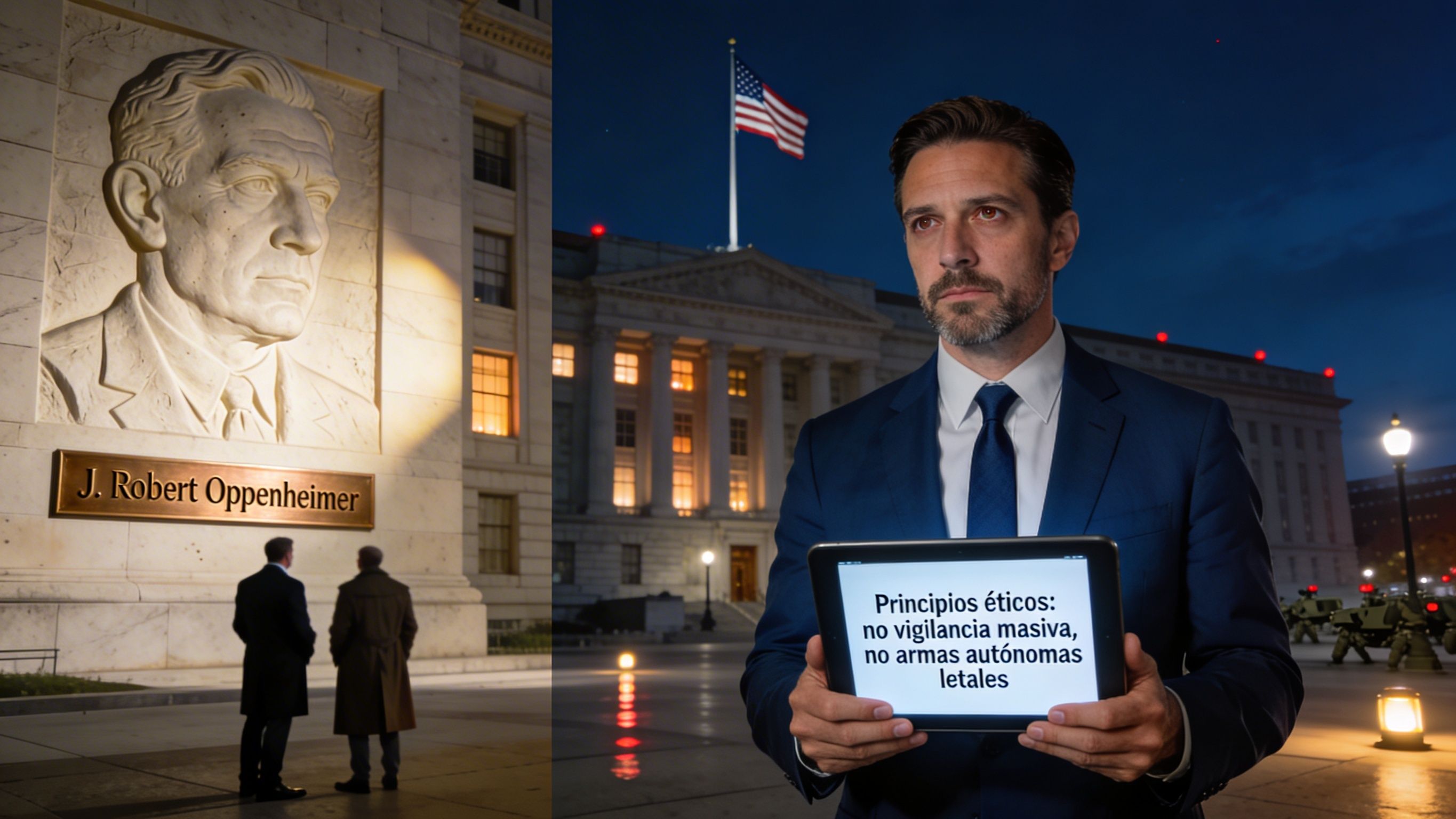

En el verano de 1945, mientras las primeras pruebas nucleares iluminaban el desierto de Nuevo México, J. Robert Oppenheimer citó el Bhagavad Gita "Me he convertido en la muerte, destructora de mundos". Era el nacimiento de una nueva era, donde el conocimiento científico ya no pertenecía solo a los laboratorios, sino que se convertía en poder absoluto. Hoy, casi ochenta años después, otro físico aunque esta vez de la inteligencia artificial se encuentra en una encrucijada muy parecida. Dario Amodei, cofundador y CEO de Anthropic, no está trabajando con uranio ni plutonio, sino con algoritmos que pueden leer, razonar y decidir. Y como Oppenheimer, enfrenta una pregunta incómoda ¿quién controla la tecnología que puede cambiar el mundo?

Un poder que no quiere servir sin condiciones

Anthropic no es una empresa cualquiera. Su modelo de inteligencia artificial, Claude, se ha convertido en una herramienta estratégica para el Gobierno de Estados Unidos. Al parecer fue utilizado para planificar el arresto del expresidente de Venezuela, Nicolás Maduro, lo que evidencia su capacidad para operar en escenarios de alto riesgo geopolítico. Pero a diferencia de muchas otras compañías tecnológicas, Anthropic no ha entregado su tecnología a ciegas. Impuso dos líneas rojas claras al Pentágono ninguna vigilancia masiva de ciudadanos estadounidenses y ninguna participación en el desarrollo de armas letales autónomas.

Estas condiciones no son meras cláusulas de contrato son principios éticos arraigados en un temor real. Temor a que la vigilancia masiva, más que defender la democracia, pueda dinamitarla desde dentro. El escándalo de la NSA con el espionaje masivo en 2013 ya mostró hasta dónde puede llegar el Estado cuando tiene acceso ilimitado a herramientas de control. Y en cuanto a las armas autónomas, el riesgo es aún más directo máquinas que deciden quién vive y quién muere sin intervención humana.

La presión del Estado cuando la tecnología se convierte en territorio nacional

El Departamento de Defensa no parece dispuesto a aceptar vetos. Quiere usar Claude como le venga en gana, siempre que, según dicen, se respete la Constitución y las leyes estadounidenses. Pero ese margen de maniobra es amplio. Y cuando Anthropic se negó a eliminar sus condiciones, el Pentágono respondió con amenazas. Una de ellas calificar a la empresa como un "riesgo para la cadena de suministro", una etiqueta que normalmente se reserva para empresas de países rivales como China o Rusia.

Este movimiento no es solo burocrático. Es simbólico. Es una señal clara de que, en la mente del Estado, cualquier tecnología clave para la seguridad nacional debe estar bajo su control absoluto. El conocimiento científico, una vez más, vuelve a tratarse como propiedad del Estado. Y quien se resiste, aunque sea por motivos éticos, puede ser tratado como un enemigo interno.

El segundo Momento Oppenheimer

La historia se repite, esta vez como drama tecnológico. J. Robert Oppenheimer, tras haber liderado el Proyecto Manhattan, intentó frenar la escalada atómica y el desarrollo de la bomba de hidrógeno. Fue despojado de sus credenciales de seguridad, sus antiguas afiliaciones políticas usadas como arma en su contra. El mensaje fue claro si el Estado necesita tu conocimiento, no puedes negarte. Y si lo haces, dejas de ser un científico y te conviertes en un traidor.

Hoy, Dario Amodei enfrenta un dilema paralelo. El Departamento de Defensa quiere, en esencia, nacionalizar la tecnología de IA de Anthropic, apropiarse de ella como se apropió del conocimiento atómico en los años 40. La analogía no es exagerada en ambos casos, un avance científico trasciende el laboratorio y se convierte en cuestión de seguridad nacional. Y en ambos casos, quien lo desarrolla se convierte en un actor político, quiera o no.

¿Hay espacio para la ética en la era de la IA militar?

Ante las amenazas del Pentágono, Amodei no ha cedido. Al contrario, ha respondido con una declaración contundente

"Estas dos últimas amenazas son inherentemente contradictorias una nos etiqueta como un riesgo para la seguridad; la otra etiqueta a Claude como esencial para la seguridad nacional"

"Los modelos fundacionales de IA simplemente no son lo suficientemente fiables como para impulsar armas totalmente autónomas. No proporcionaremos, a sabiendas, un producto que ponga en riesgo a los combatientes y civiles estadounidenses"

Además, ha ofrecido ayudar al Departamento de Defensa a migrar a otro proveedor si no aceptan sus condiciones. Una salida elegante, pero también una advertencia no todos los avances tecnológicos deben militarizarse por defecto.

El mensaje para el futuro

Si el Pentágono decide vetar a Anthropic, el impacto irá mucho más allá de una sola empresa. El mensaje será claro en la era de la IA no hay objetores de conciencia. Si desarrollas una tecnología que da ventaja estratégica, ya no es tuya. Pertenecerá al Estado. Y si te niegas a colaborar sin límites, puedes terminar marginado, desacreditado o sancionado.

Estamos ante un nuevo y terrorífico "Momento Oppenheimer", no con explosiones nucleares, sino con decisiones algorítmicas. Un momento en el que los creadores de inteligencia artificial deben decidir si quieren ser arquitectos del poder absoluto o guardianes de los límites éticos. Y en el que el resto de la sociedad debe preguntarse ¿hasta dónde queremos que el Estado controle lo que pensamos, vigilamos y destruimos? Porque esta no es solo una batalla entre un CEO y el Pentágono. Es una batalla por el alma de la tecnología del siglo XXI.