El mundo de la inteligencia artificial no ha dejado de sorprender en los últimos años, pero esta vez la noticia no viene por un nuevo modelo más potente o una aplicación revolucionaria. Viene por una salida. La dimisión de Caitlin Kalinowski, responsable del equipo de robótica de OpenAI desde noviembre de 2024, ha sacudido el ecosistema tecnológico con un impacto que va más allá del círculo corporativo. Su decisión no fue técnica ni estratégica. Fue ética. Y eso cambia las reglas del juego.

Una salida con principios

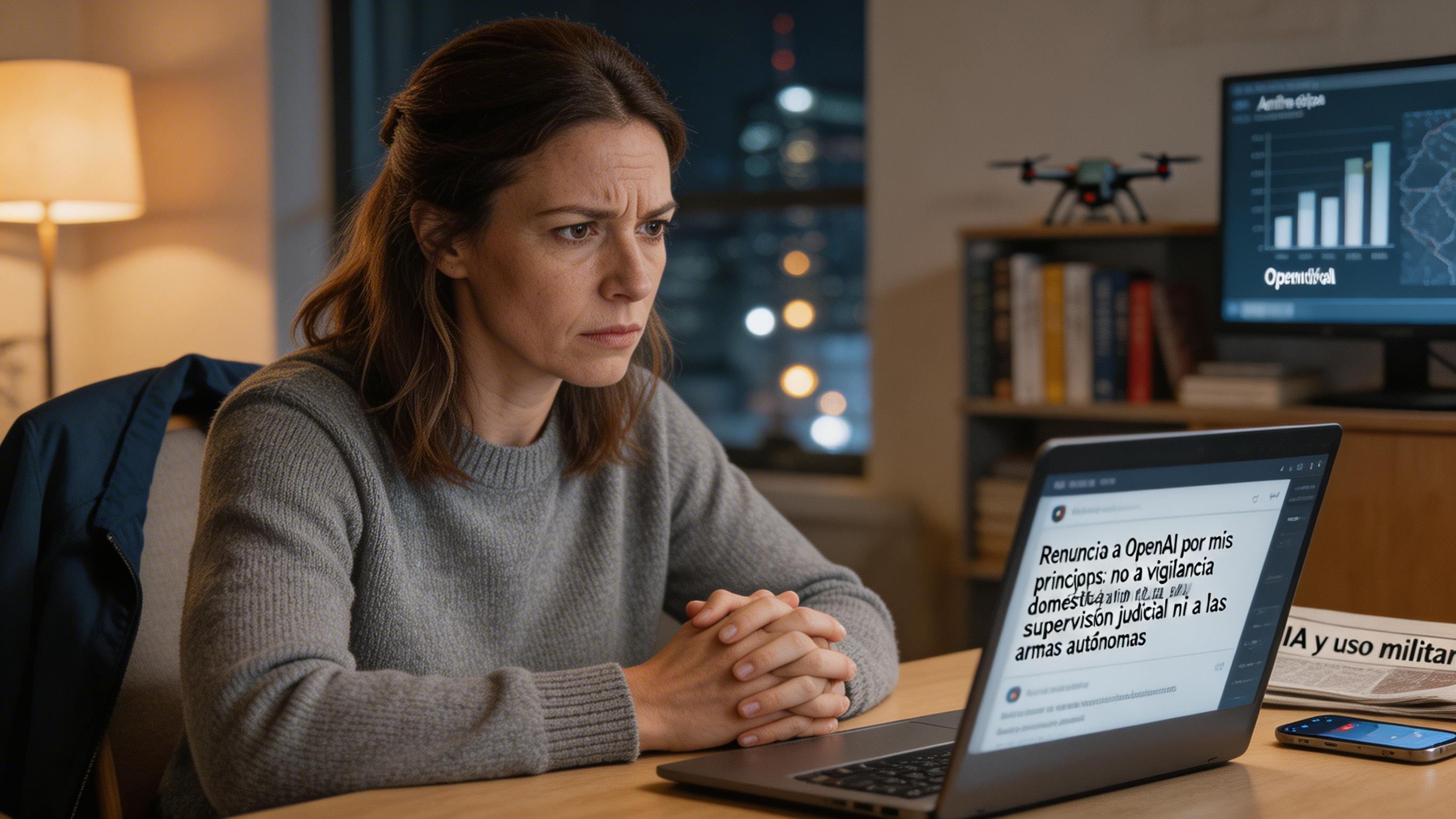

Kalinowski anunció su salida en redes sociales con un tono sereno pero firme. "Va de principios y no de personas", escribió. Una frase que suena a despedida limpia, pero también a advertencia. Su salida no es solo personal. Es un juicio colectivo sobre hacia dónde se dirige una de las empresas más influyentes en el desarrollo de la inteligencia artificial.

En su declaración, señaló dos líneas rojas que, según ella, OpenAI no deliberó lo suficiente internamente la vigilancia de la ciudadanía estadounidense sin supervisión judicial y el desarrollo de armas autónomas capaces de disparar sin intervención humana. Son dos conceptos que, aunque técnicamente posibles desde hace años, tocan fibras profundas en cualquier debate sobre ética y poder. La tecnología ya no es solo una herramienta neutral; puede convertirse en un mecanismo de control o de destrucción masiva.

El contexto militar de la IA

Este movimiento se inserta en un escenario de tensiones crecientes. Mientras OpenAI firma un acuerdo para desplegar sus modelos de inteligencia artificial en redes clasificadas del Departamento de Defensa de Estados Unidos, Anthropic, otra empresa puntera en el sector, decide precisamente lo contrario retirarse del Pentágono. Su transición será gradual, en seis meses, pero su mensaje es claro hay límites que no se deben cruzar.

Anthropic ha establecido barreras firmes frente a la vigilancia doméstica y las armas autónomas. Una decisión que, aunque implica renunciar a un contrato lucrativo, fortalece su reputación ética. En contraste, OpenAI afirma que su acuerdo con Defensa excluye específicamente esos usos. Pero la mera asociación con el aparato militar genera desconfianza, especialmente cuando las promesas no son visibles ni verificables.

Las consecuencias no se hicieron esperar. Miles de personas desinstalaron ChatGPT como gesto de protesta. No es solo un dato de uso. Es una señal política. Los usuarios ya no consumen tecnología como si fuera un bien neutro; la juzgan por sus implicaciones sociales y morales.

Fracturas internas y presión externa

La dimisión de Kalinowski es la primera de un alto cargo en OpenAI por desacuerdos éticos explícitos sobre el uso militar de la IA. No se trata de una salida silenciosa ni de una reestructuración técnica. Es una ruptura pública, con nombre y cargo. Y eso expone una fractura interna en una empresa que, desde sus inicios, se presentó como un proyecto de beneficio colectivo.

En los comentarios a su publicación, ante la pregunta de cuántas personas más podrían haber abandonado la empresa tras el acuerdo con el Pentágono, Kalinowski fue evasiva no puede compartir detalles internos. Pero el silencio también habla. Sugiere que no está sola en su preocupación.

El caso refuerza una idea que muchos ya sospechaban la autorregulación en inteligencia artificial no es suficiente. Las empresas no pueden ser juez y parte cuando se trata de definir hasta dónde puede llegar el poder de sus creaciones. El caso de OpenAI y su vínculo con el Departamento de Defensa es un ejemplo perfecto un movimiento que muchos ven como oportunista, y que ha erosionado la confianza de usuarios, empleados y observadores externos.

El futuro de la IA entre la ética y el poder

Anthropic gana puntos en credibilidad ética, aunque asume riesgos económicos. OpenAI gana acceso a recursos y datos sensibles, pero pierde buena parte de su capital moral. Y mientras tanto, el debate sobre la necesidad de legislar la inteligencia artificial se hace más urgente que nunca.

Estamos ante un punto de inflexión. No se trata solo de si la IA puede o no ayudar a ganar guerras. Se trata de quién decide cómo se usa, bajo qué condiciones, y con qué límites. La tecnología no avanza en el vacío. Avanza con decisiones, con valores, con responsabilidades.

La dimisión de Caitlin Kalinowski no es el final de una historia. Es el comienzo de otra. Una en la que los principios no son un detalle técnico, sino el centro del debate.