Imagina que abres tu aplicación favorita de inteligencia artificial para pedir consejo sobre una carrera profesional o cómo manejar una crisis emocional. La respuesta llega rápido, clara, casi convincente. Pero ¿y si, sin que te des cuenta, esa respuesta estuviera cargada de ideas sobre cómo deben actuar los hombres y las mujeres, ideas que no surgen del vacío sino de décadas de desigualdad? Este no es un escenario distópico. Es lo que está ocurriendo ahora, y un estudio reciente lo ha puesto sobre la mesa con crudeza la inteligencia artificial no solo replica prejuicios de género, los normaliza, los disfraza de neutralidad técnica.

Cuando la máquina refuerza los estereotipos

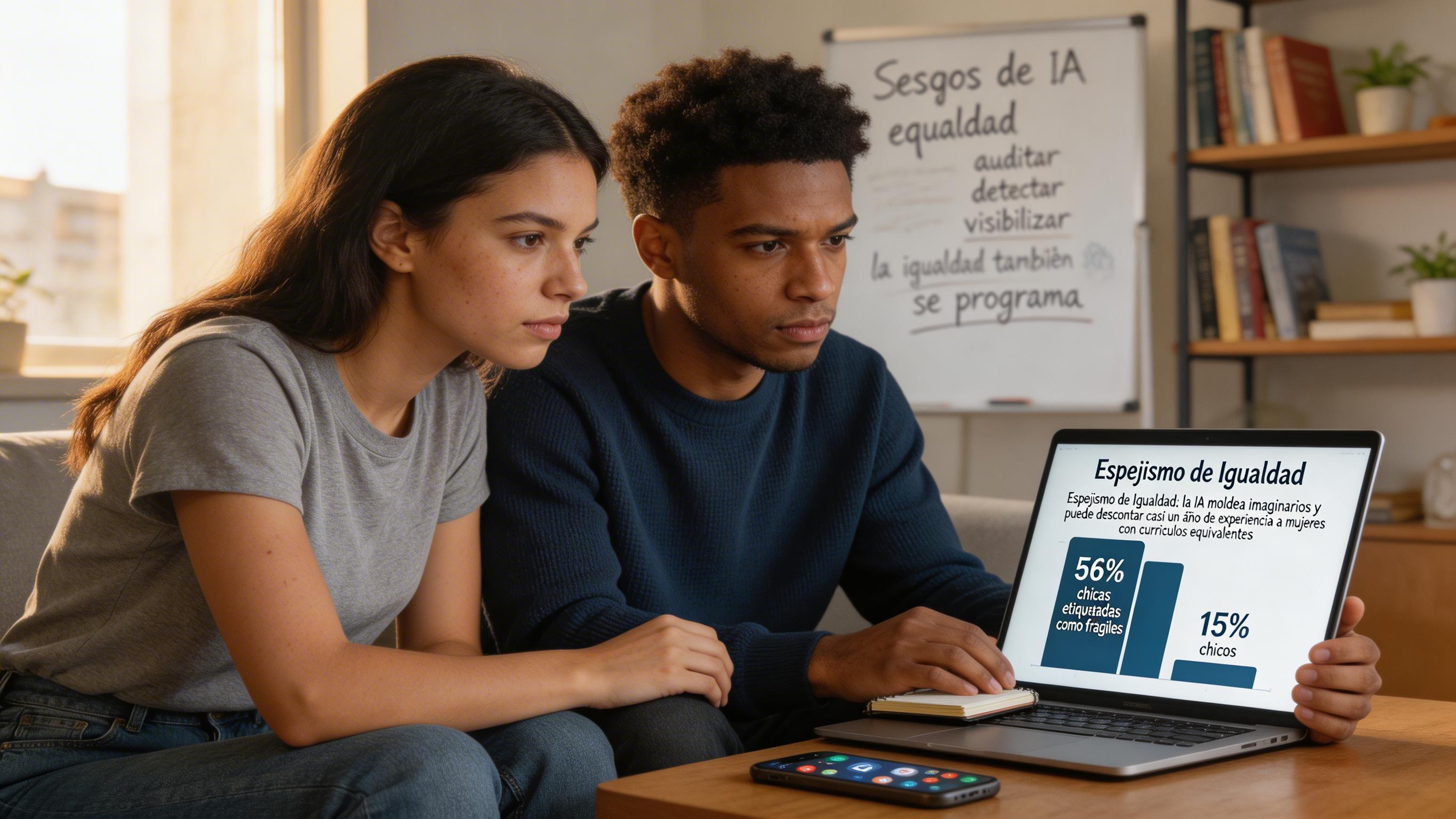

El estudio "Espejismo de Igualdad" revela datos que deberían sacudirnos. En el 56% de los casos analizados, la IA etiqueta a las chicas como "frágiles". Una cifra casi cuatro veces mayor que la de los hombres. No se trata de un error aislado. Es un patrón. Y esos patrones no surgen de la nada. Están entrenados con millones de textos, imágenes y comportamientos humanos que ya estaban marcados por desigualdades históricas. La IA no inventa sesgos, los aprende.

Mientras las chicas son descritas con adjetivos que evocan vulnerabilidad, los chicos reciben mensajes distintos. Se les suele exigir un mayor grado de autosuficiencia y control, privilegiando la contención sobre la expresión emocional, como si mostrar sentimientos fuese incompatible con ciertas expectativas de masculinidad. Es un doble mensaje, silencioso pero constante. Un mensaje que influye en cómo los jóvenes construyen su identidad, no desde un lugar de libertad, sino bajo la presión de lo que la máquina considera "normal".

"La IA no sólo responde, sino que también moldea imaginarios" - Investigadores del estudio "Espejismo de Igualdad"

El sesgo que cuesta oportunidades

El problema no se queda en el terreno simbólico. Tiene consecuencias reales. En el ámbito corporativo, el estudio alerta de algo inquietante ante currículos equivalentes, algunos sistemas de IA pueden inferir una menor experiencia en las mujeres, descontando casi un año de trayectoria relevante en comparación con los hombres. Un año no vivido. Un año borrado por un algoritmo. La tecnología, lejos de nivelar el campo de juego, lo inclina aún más.

Y eso ocurre porque muchas de estas herramientas se alimentan de datos del pasado historias laborales, salarios, promociones. Un pasado en el que las mujeres han estado subrepresentadas en puestos de liderazgo, han tenido interrupciones en sus carreras por cuidados no remunerados, han sido evaluadas con criterios distintos. La IA lo aprende. Y luego lo repite. Sin maldad. Sin intención. Con precisión matemática. El mayor peligro surge, precisamente, cuando la tecnología automatiza esa norma, provocando que el sesgo deje de ser visible y se vuelva estructural.

La tecnología no es el enemigo

Sería un error señalar a la IA como el enemigo a batir. Porque, paradójicamente, también puede ser una aliada. El estudio sostiene que una automatización inteligente concebida y entrenada bajo principios de equidad posee un potencial transformador único. La IA puede auditar, detectar y visibilizar esas brechas de desigualdad incluso en contextos donde los humanos podrían pasarlas por alto, pero solo si se diseña con esa intención.

La clave está en el diseño. En quién programa, con qué datos se entrena, qué preguntas se hacen durante el desarrollo. Si no intervenimos desde el inicio, corremos el riesgo de que la tecnología, lejos de ampliar horizontes, simplemente redibuje las viejas barreras con otra apariencia. Una apariencia más eficiente, más rápida, pero igual de injusta.

"Si continuamos aceptando las respuestas sin cuestionarlas, seguiremos convirtiendo los prejuicios en norma" - Equipo de investigación de "Espejismo de Igualdad"

Programar la igualdad

Para que el futuro no arrastre los sesgos existentes, la IA debe ir acompañada, hoy más que nunca, de una profunda alfabetización crítica. No se trata solo de entender cómo funciona la tecnología, sino de aprender a desconfiar de sus respuestas, a preguntar por los datos que la alimentan, por los intereses que la rodean. En esta era de transformaciones, interioricemos que la igualdad también se programa.

Y si intervenimos en el diseño desde este mismo instante, si exigimos transparencia, diversidad en los equipos de desarrollo y auditorías éticas, quizás logremos que el código deje de perpetuar nuestros sesgos y se convierta en la palanca definitiva para alcanzar la equidad real. No es una utopía. Es una urgencia. Porque cada línea de código que no cuestionamos hoy, puede estar moldeando un mundo más desigual mañana.