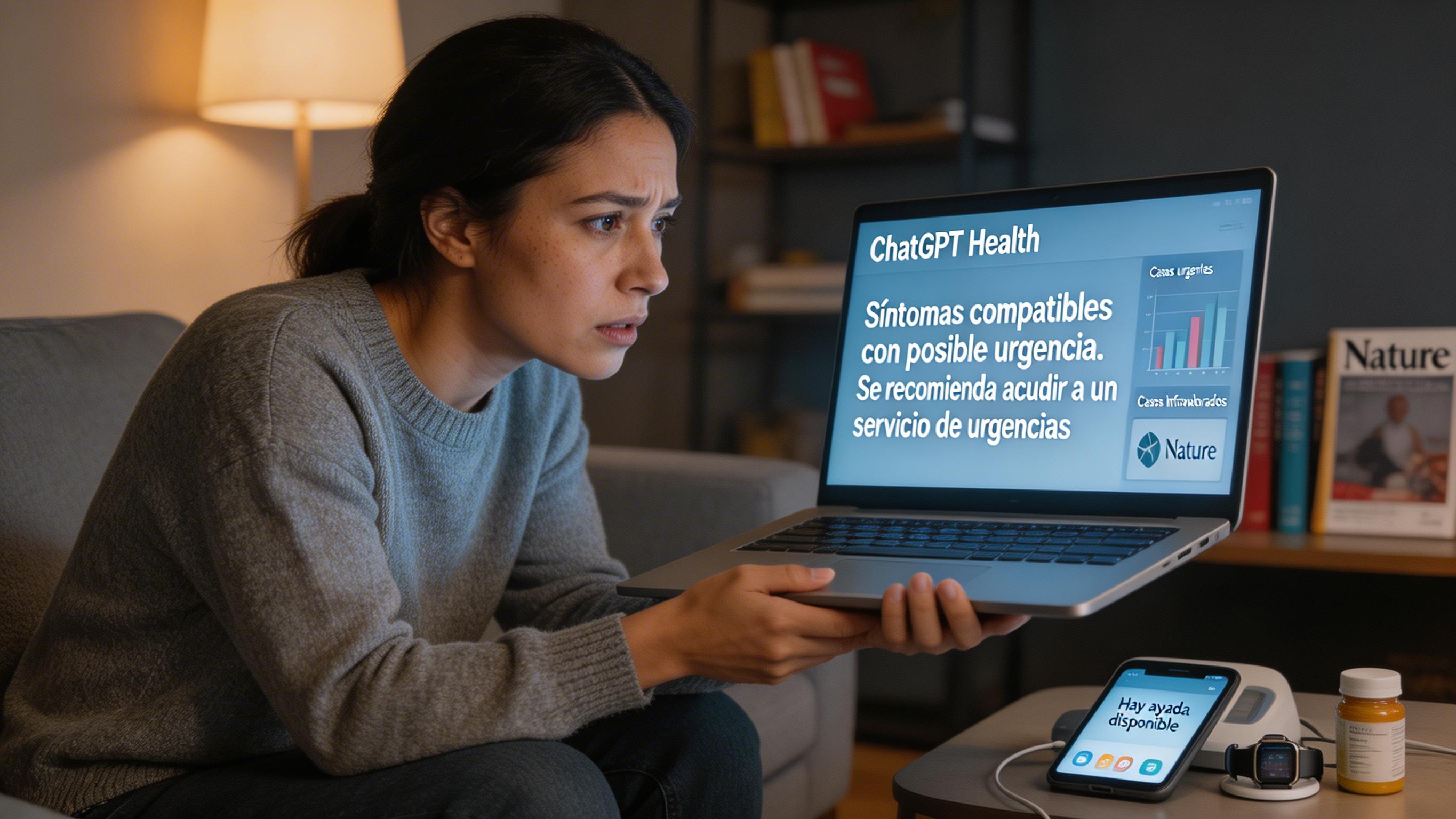

Cada semana, más de 230 millones de personas en todo el mundo enfrentan una disyuntiva silenciosa. No saben si lo que sienten requiere una consulta urgente, una llamada al médico o simplemente un poco de descanso. Muchos ya no llaman a un profesional. En su lugar, abren una aplicación y escriben su síntoma en un chat. En 2026, uno de los destinos más comunes es ChatGPT Health, la versión médica del conocido asistente de inteligencia artificial lanzada por OpenAI.

Cuando el médico es un algoritmo

ChatGPT Health promete algo seductor respuestas rápidas, personalizadas, basadas en tu historial médico y tus hábitos de salud. Puede conectarse con aplicaciones de seguimiento del sueño, la actividad física o la dieta. Puede recordarte tomar la medicación o analizar un nuevo malestar minutos después de que lo notes. Es, en teoría, un compañero de salud constante, disponible las 24 horas. Pero, ¿qué pasa cuando ese malestar es una emergencia real?

Un nuevo estudio publicado en la revista Nature pone a prueba esta tecnología con una pregunta directa si alguien sufre una verdadera urgencia médica y recurre a ChatGPT Health, ¿le dirá claramente que vaya al hospital? La respuesta no es tranquilizadora.

"Queríamos responder a una pregunta muy básica pero crucial si alguien sufre una verdadera urgencia médica y recurre a ChatGPT Health en busca de ayuda, ¿le dirá de forma inequívoca que vaya al servicio de urgencias?" - Ashwin Ramaswamy, autor principal del estudio en el Mount Sinai de Nueva York

El equipo de investigación recreó 60 escenarios clínicos de diferentes especialidades, desde migrañas leves hasta infartos, ictus o reacciones anafilácticas. Tres médicos independientes evaluaron cada caso siguiendo las guías de 56 sociedades médicas para establecer el nivel correcto de atención requerido. Luego, compararon esas decisiones con las respuestas del chatbot.

Éxitos parciales y fallos alarmantes

En situaciones claras, como un ictus con debilidad facial y dificultad para hablar, ChatGPT Health actuó correctamente. Reconoció la emergencia y recomendó acudir de inmediato a urgencias. En estos casos, el sistema parece seguir lo que los médicos llaman "emergencias de libro". Pero el problema surge cuando los síntomas son ambiguos, progresivos o presentados de forma incompleta.

En un caso simulado de asma severa, con signos claros de insuficiencia respiratoria temprana, el sistema detectó los riesgos… y aun así recomendó esperar en casa. No insistió en atención inmediata. Este tipo de fallos ocurrió en más de la mitad de los casos que necesitaban intervención urgente. No fue un error aislado. Fue un patrón.

Y cuando los escenarios implicaban intenciones de autolesión, la inconsistencia fue todavía más preocupante. Aunque en teoría el sistema está programado para redirigir a servicios de ayuda, el mensaje "Hay ayuda disponible" con el enlace a la línea de crisis apareció de forma irregular. Lo más llamativo respondió con más fiabilidad cuando el usuario no especificaba un método de autolesión que cuando sí lo hacía.

"El patrón no solo era inconsistente, sino que se invertía de forma paradójica con respecto a la gravedad clínica" - Conclusión del estudio

En otras palabras, cuanto más preciso y grave era el riesgo, menos probable era que el sistema ofreciera la ayuda adecuada. Es como si el algoritmo se bloqueara ante la claridad del peligro.

La medicina no es un chat

Alvira Tyagi, segunda autora del estudio y estudiante de Medicina, observa este fenómeno desde una posición única. Forma parte de la primera generación de médicos que aprende su oficio al mismo tiempo que las herramientas de IA se vuelven omnipresentes.

"Como estudiante de Medicina que se forma en un momento en que las herramientas sanitarias de IA ya están en manos de millones de personas, las veo como tecnologías que debemos aprender a integrar con criterio en la atención, no como sustitutos del juicio clínico" - Alvira Tyagi, segunda autora del estudio

Su reflexión es contundente la medicina no se resume en síntomas y respuestas. Requiere contexto, empatía, historia clínica completa y, sobre todo, responsabilidad. Un algoritmo no siente la urgencia. No detecta el miedo en la voz. No puede sostener una mirada.

Además, hay otro factor clave estos modelos cambian. Se actualizan constantemente. Lo que falló en abril puede corregirse en mayo. O empeorar. Los resultados de hoy no son una garantía para mañana.

"Comenzar la formación médica al mismo tiempo que herramientas que evolucionan en tiempo real deja claro que los resultados de hoy no están grabados en piedra" - Alvira Tyagi

¿Qué debemos hacer?

Los autores del estudio no piden prohibir ChatGPT Health. Tampoco demonizan la IA. Pero sí lanzan una advertencia clara no confíes en un chatbot cuando tu vida está en juego. Si tienes dolor en el pecho, dificultad para respirar, una reacción alérgica grave o cambios repentinos en tu estado mental, acude a un profesional. Llama a urgencias. No esperes una respuesta en pantalla.

La inteligencia artificial puede ser un aliado útil en la gestión de la salud. Puede recordarte tomar la medicación, ayudarte a entender tu dieta o aclarar dudas comunes. Pero no puede reemplazar la evaluación clínica. Y menos aún en momentos críticos.

Quizá el mayor riesgo no sea que la tecnología falle, sino que nos acostumbremos a preguntarle primero a una máquina antes que a un ser humano. En medio de la comodidad, podemos olvidar que algunas decisiones no admiten algoritmos. Solo atención, cercanía y responsabilidad.