Doce meses. Eso es todo lo que ha pasado desde que NVIDIA cerró su último ejercicio fiscal. Pero en ese breve lapso, la empresa ha vivido una transformación tan radical que parece pertenecer a otra era. Un beneficio neto de 120.000 millones de dólares. Casi tres veces el PIB de un país como Costa Rica. Y un salto brutal apenas tres años atrás, sus ganancias rondaban los 4.400 millones. Hoy, NVIDIA no solo compite en el sector tecnológico. Está redefiniendo lo que significa ser una de las compañías más poderosas del planeta.

El imperio del cómputo

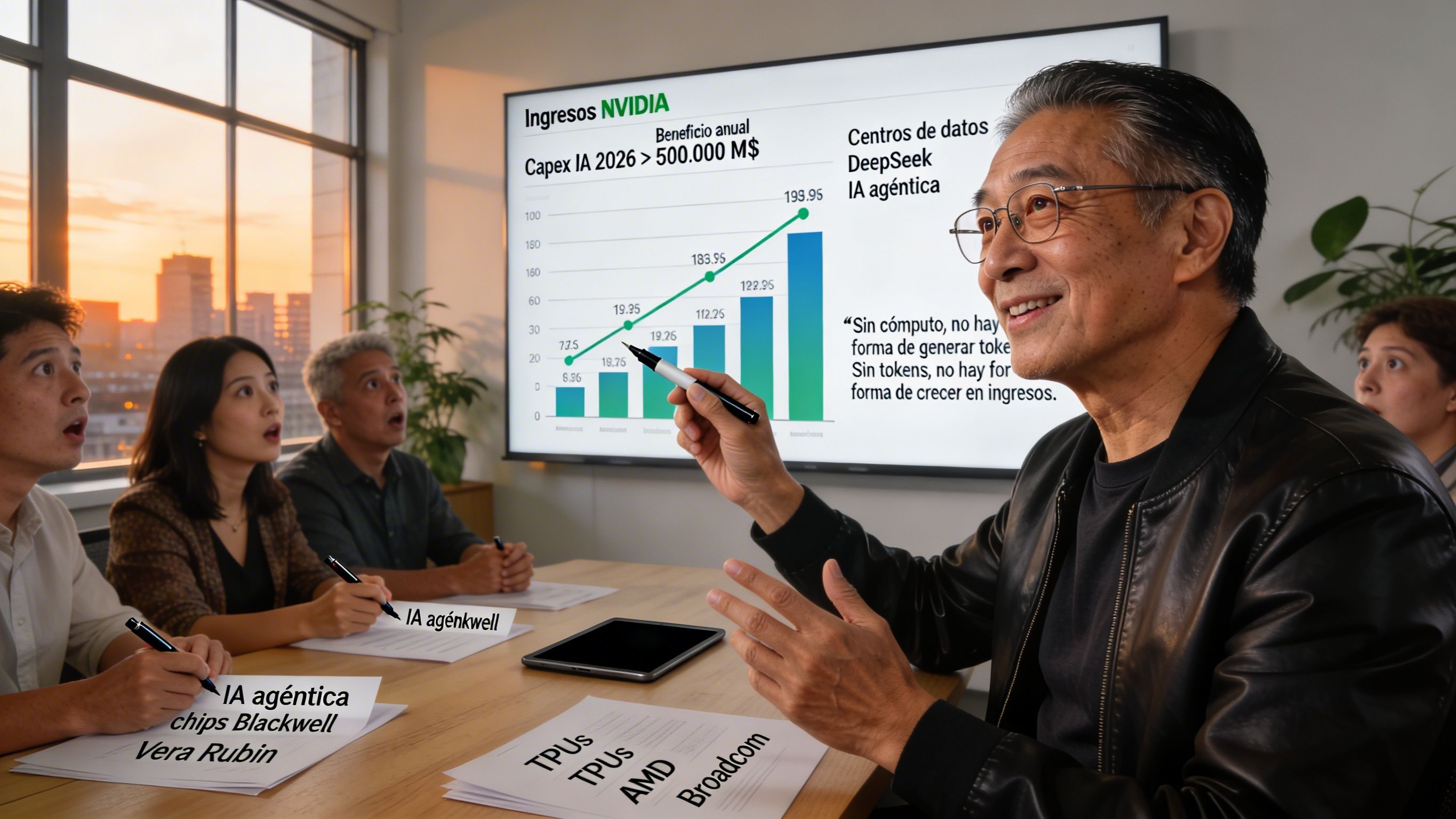

Detrás de cada mensaje generado por una IA, de cada recomendación personalizada o diagnóstico asistido por algoritmos, hay un chip. Y en muchos casos, ese chip es de NVIDIA. Su negocio de centros de datos, el motor oculto de la revolución de la inteligencia artificial, facturó 62.300 millones de dólares en el último año. Un crecimiento del 71% respecto al ejercicio anterior. No es solo volumen. Es dominio. Con un margen bruto del 75%, cada dólar que ingresa se convierte en casi tres cuartos de beneficio puro.

Los números más llamativos vienen de sus líneas más estratégicas. Los chips Blackwell, diseñados específicamente para IA de alto rendimiento, han multiplicado su aporte de 32.600 millones a 51.300 millones de dólares en ingresos. Pero quizás lo más revelador sea el salto en redes. Tecnologías como NVLink, Spectrum-X e InfiniBand, que permiten que miles de chips trabajen a la vez como si fueran uno solo, han pasado de 3.000 a 11.000 millones. La infraestructura invisible del futuro ya está generando billones en valor.

La economía del token

Jensen Huang, fundador y CEO de NVIDIA, lo dice sin rodeos: "Sin cómputo, no hay forma de generar tokens. Sin tokens, no hay forma de crecer en ingresos". Es una frase contundente, casi dogmática. Pero encierra una tesis económica poderosa. En el nuevo mundo de la IA, el cómputo ya no es un costo. Es una fuente directa de ingresos. Cada operación que una empresa realiza con inteligencia artificial cada respuesta, cada análisis, cada imagen generada se mide en tokens. Y para procesarlos, se necesitan GPUs.

Esta lógica ha convencido a los gigantes del cloud computing. Google, Amazon, Microsoft y Meta están preparando inversiones masivas. Sus presupuestos combinados para construir centros de datos especializados en IA superarán los 500.000 millones de dólares en 2026. No están comprando tecnología. Están construyendo fábricas de inteligencia artificial. Y en el corazón de esas fábricas, casi invariablemente, hay chips de NVIDIA.

¿Y si la IA fuera más eficiente?

A principios de 2025, un modelo chino llamado DeepSeek irrumpió con fuerza. Su promesa ofrecer capacidades similares a las de los grandes modelos occidentales, pero con una fracción del coste computacional. Hubo quien vio en esto una amenaza. Si la inferencia el proceso de usar un modelo ya entrenado se vuelve más eficiente, ¿no disminuirá la necesidad de chips?

La respuesta, paradójicamente, fue lo contrario. La eficiencia no mata la demanda. La libera. Al reducir el coste por token, las empresas pueden desplegar más aplicaciones, más rápido y a mayor escala. Es la paradoja de Jevons aplicada a la IA cuanto más eficiente es la tecnología, más se consume. La eficiencia no reduce la necesidad de cómputo. La multiplica.

El salto a la IA agéntica

La próxima frontera no son los chatbots. Es la IA agéntica. Sistemas que no solo responden, sino que toman decisiones, ejecutan tareas, interactúan con otros sistemas y persisten en el tiempo. Huang lo afirma con certeza: "la adopción empresarial de agentes se está disparando".

Y esto cambia todo. Un agente de IA que gestiona una cadena de suministro, negocia contratos o monitorea infraestructuras requiere miles de ciclos de inferencia. Mucho más que un simple diálogo. Cada agente activo es un motor de consumo computacional constante. La demanda no crece en línea recta. Lo hace exponencialmente.

El futuro ya está en camino

Mientras algunos debaten sobre eficiencia, NVIDIA ya está en la siguiente generación. Colette Kress, directora financiera de la compañía, confirmó que las primeras muestras del nuevo chip Vera Rubin han sido enviadas. Llegará a lo largo de este año y promete un salto aún mayor en rendimiento y eficiencia energética.

Las previsiones para el próximo trimestre apuntan a 78.000 millones de dólares en ingresos. Una cifra que, curiosamente, no incluye nada proveniente del mercado chino. Desde que la administración estadounidense autorizó parcialmente la venta de ciertos chips, como el H20, los ingresos de NVIDIA en China apenas suman 60 millones de dólares según documentos presentados ante la SEC. Y aún no ha registrado ventas del H200, el modelo más reciente aprobado. El gigante tiene margen para crecer incluso en los escenarios más restringidos.

¿Quién puede competir?

No faltan intentos. AMD avanza con sus instancias MI300X. Broadcom ofrece soluciones de conectividad clave. Google apuesta fuerte con sus TPUs, chips personalizados para IA. Pero ninguno logra replicar el ecosistema completo que NVIDIA ha construido hardware, software, redes y herramientas de desarrollo integradas.

Y mientras los competidores corren, el tren sigue acelerando. Huang tiene una visión clara del futuro "Cada empresa depende del software, y todo el software dependerá de la IA". No es una predicción. Es una declaración de intenciones. El cómputo no es el futuro de la tecnología. Es el presente de todo.